AI时代,人机交互研究面临新的命题与新的挑战,研究方法也需要不断丰富升级。

眼动研究是我们探索人类注意和认知规律的主要手段,它通过记录眼球的真实运动,描述人的视觉行为,反映人的认知加工和心理活动。面向AI时代的交互设计研究,眼动研究有哪些升级,可以帮助我们解决哪些问题,在方法层面上又有哪些延展?

本文聚焦于AI交互中的眼动研究和传统互联网眼动研究的异同,从眼动技术本身、研究内容的延展、眼动分析思路的差异、眼动研究注意事项,这四个方面,来探讨AI时代眼动研究的变与不变。

AI对眼动研究的技术升级

眼动仪经历百余年的发展历程,从最初的用镜子直接观察,到中间通过机械转动将眼球与记录装置连接,到现在的高精测量,

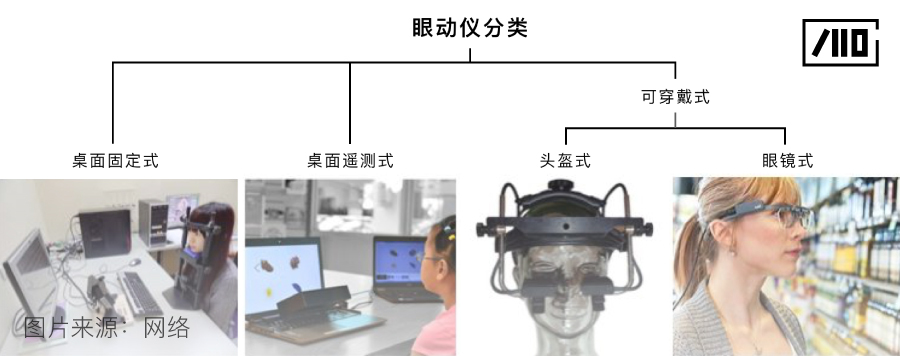

实现了准确度、精确度和被试自由度的大幅提升。目前主流的眼动仪采用的都是基于光电记录法的瞳孔角膜反射技术。根据眼动仪的外形结构差异,可将其分为桌面固定式、桌面遥测式、可穿戴式。

AI技术在可穿戴式的基础上,发展了VR嵌入式眼动仪。

通过搭建3D虚拟场景,眼动研究可以兼容更多实验场景,为用户提供沉浸式的临场感,并能以较低成本实现实验物料的快速切换。

以传统的汽车外观研究为例,其可能需要开模等复杂的工序,耗时长、成本高。而利用3D建模,就能够以较低成本构建等比例立体模型,并提供360°的全方位查看视角。

传统研究需要用户到搭建好的实验现场进行测试,3D建模则打破了实验场景对用户的限制,使多人多地同时执行成为可能,极大提高了眼动数据的样本采集效率。

VR技术使多种研究方案的快速切换和自由控制成为可能,极大丰富了实验内容。如传统市场研究中的货架摆放研究,实验准备需要大量工作,要提前将货架摆置好。此外受空间限制,测试方案也比较有限。但通过3D建模,就可以低成本得到多种摆放方案,并且实现较细颗粒度的不同方案对比。

过去由于行业危险性而较少涉足的研究领域,会在VR技术的协助下获得发展。如车载相关研究,在真实道路测试比较危险,搭建模拟驾驶实验室的成本又高,VR既可以解决实验的安全问题与成本问题,还可以控制道路的复杂程度。

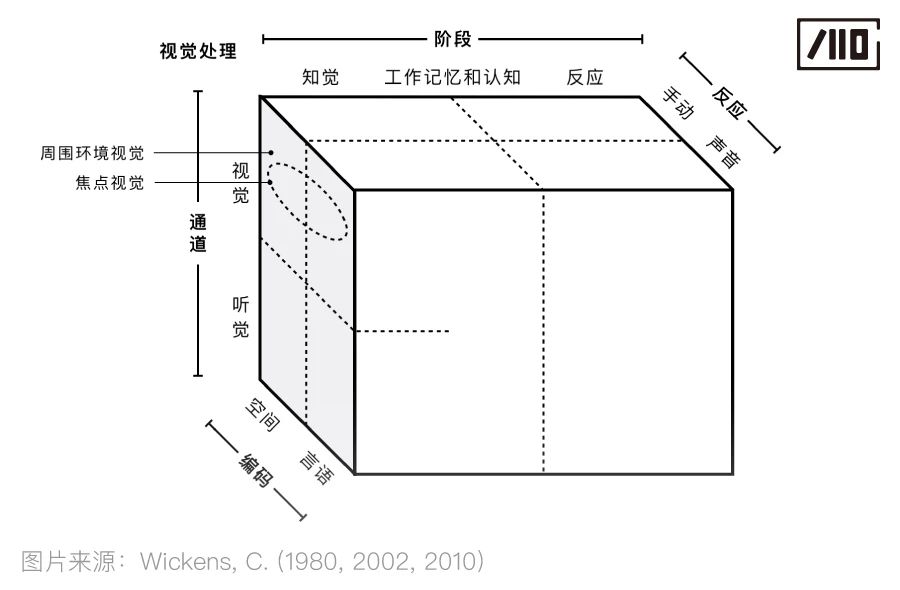

根据人因学、工程心理学泰斗Wickens教授提出的多资源理论模型,人接受信息及执行或表达信息是一个立体交互过程。根据多资源理论,在衡量多通道交互的用户体验时,我们要特别注意这两个问题:①多任务操作时,单一通道的使用;②单任务操作时,不同通道间的配合。而在大脑所有的信息输入来源中,视觉因素占70%,所以在多通道研究中,基于视觉的人因研究至关重要。

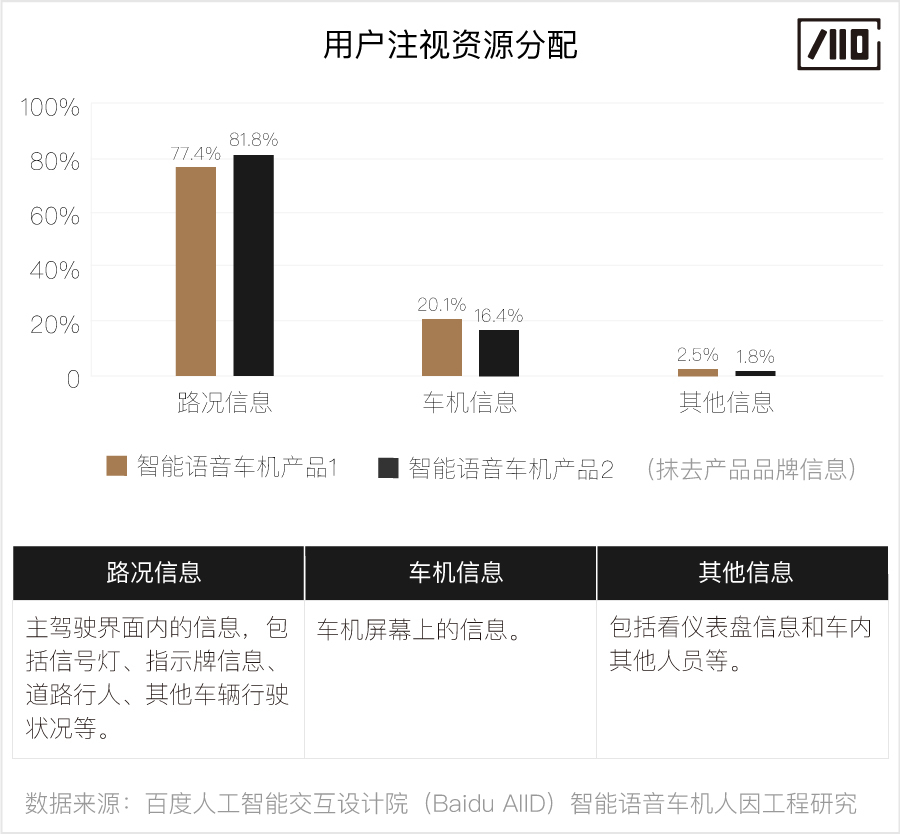

眼动研究主要研究在多通道的配合中,视觉单通道的资源占用情况。以智能语音车机为例,视觉通道是司机在行车过程中的主要信息来源,而车机作为车上娱乐信息系统,使驾驶员在完成驾驶主任务之外,还执行着大量和驾驶无关或不直接相关的驾驶次级任务。这些次级任务会在不同程度上占用驾驶员的视觉资源、认知资源和动作资源,影响驾驶绩效。

为了研究车机系统对司机视觉资源的占用,我们采用Tobii Glasses2眼动仪,采集驾驶员在真实路况上驾驶时的眼动信息,得到行车状态下两种智能语音车机在执行交互任务时,对用户注意资源的占用情况。

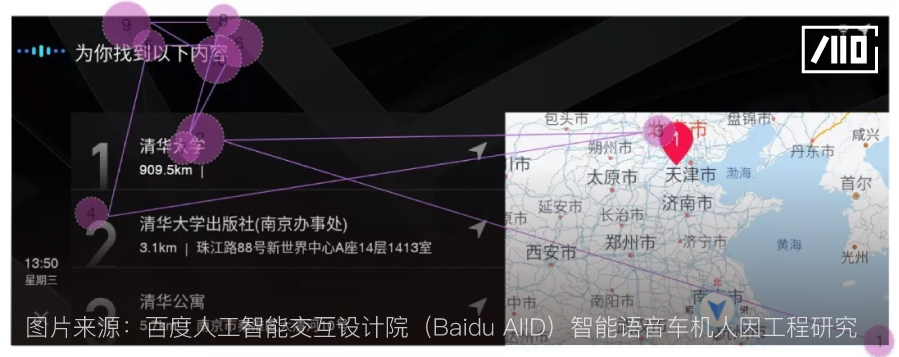

试听通道的配合,是多通道研究的重点内容。同样以智能车机研究为例,车机的交互流程、语音交互体验,包括响应速度、引导话术、屏幕UI设计等都会影响到用户视听资源的分配。在研究中,我们通过眼动热力图的分布和密度衡量不同引导话术对用户视觉资源使用的影响。

情感交互是AI研究的重要领域,情绪识别和情绪应对构成了情感研究的两大块内容。眼动研究除描述和分析注视等数据之外,也可以利用瞳孔直径观察情绪刺激的反应。因为瞳孔的扩大和收缩受到自主神经系统的支配,而情感的处理也受到自主神经系统的支配,因此瞳孔直径被用来分析由不同情绪刺激材料所诱发的情感反应。在国外和国内的相关研究中,有结论表明瞳孔的放大与情感唤醒度呈线性关系,即瞳孔直径越大代表唤醒度越高。

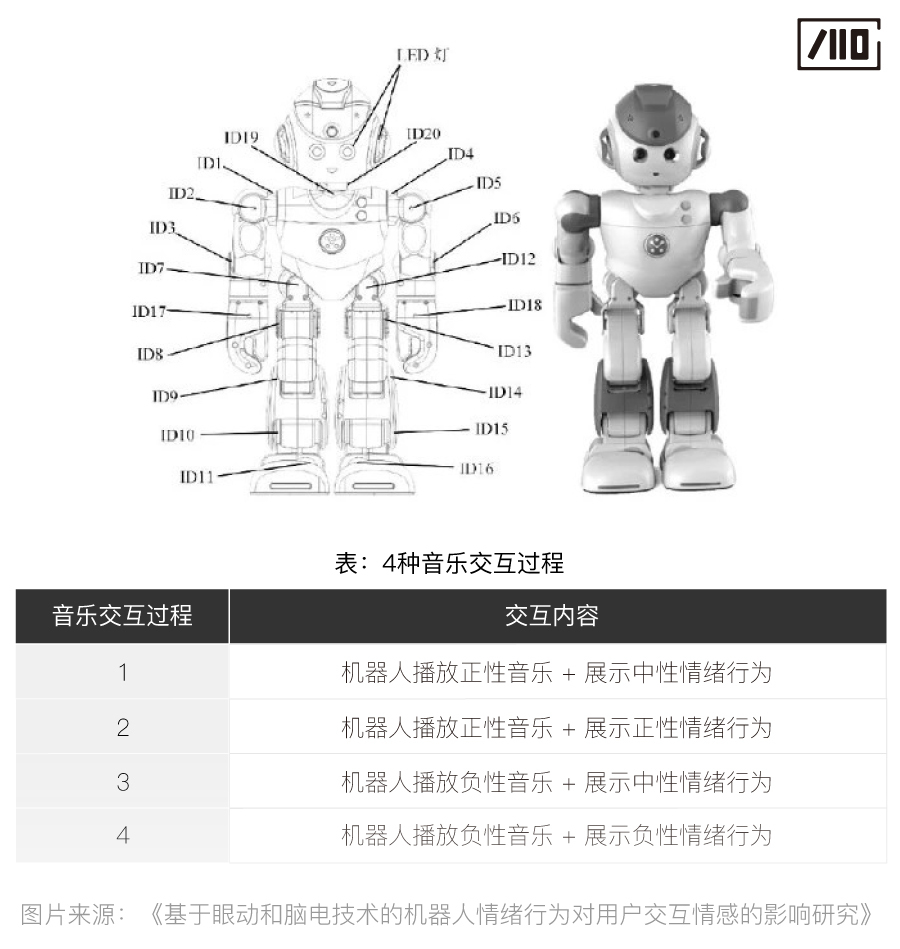

比如发布在《人类工效学》上的《基于眼动和脑电技术的机器人情绪行为对用户交互情感的影响研究》一文,用眼动测量得到瞳孔直径判断人和机器人交互时的情绪唤醒度,用脑电测量得到的额中线theta波和额区alpha波的不对称性判断用户的情绪效价。

基于眼动和脑电技术的机器人情绪行为对用户交互情感的影响研究

澳大利亚大学和斯图加特大学联合公布了一个人工智能项目实验结果,研究人员采用SensorMotoric Instruments的视频眼动仪监测42名参与实验的人类眼球运动,最后采用人工智能机器学习算法准确的预测出每个人的个性。

互联网应用中的眼动研究主要集中在页面的可用性测试,设计方案的AB test、页面广告及广告位的研究等。

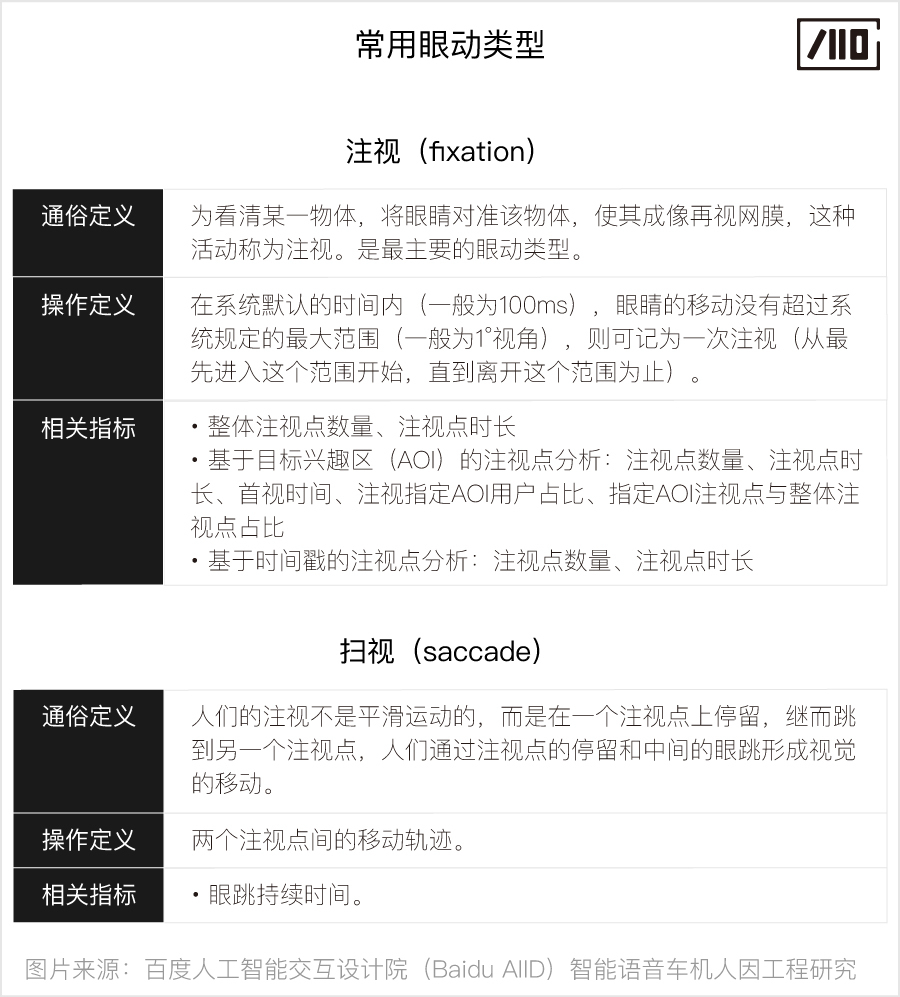

常用基础眼动类型:注视(fixation)、扫视(sacccade)和追随(persuit movement)。因为互联网应用研究一般不涉及到通过眼动探索更深层次的生理原因,使用指标较少,本文暂讨论常用指标。

注视及扫视示意,来源:AIID智能语音车机人因工程研究

可视化方法有热力图(heatmap)、轨迹图(gaze plot),及眼动录像(gaze video):

眼动录像示意,来源:AIID智能语音车机人因工程研究

对于AI智能产品交互中的眼动研究,常见指标是一样的。

不同的,是体验目标和分析思路。

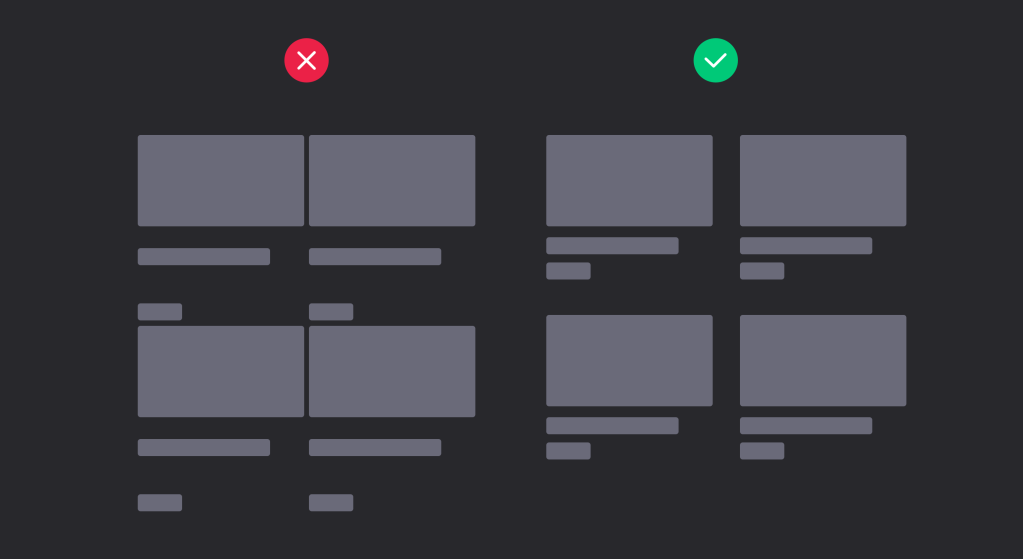

PC和移动产品的交互体验有“强注意力”的特点,我们希望获取用户更多的注意力。因此传统的网页研究或者广告研究,通常为视觉单一通道的研究,在热力图的分析中以用户注视多的方案为优。而AI交互希望打造自然、低成本、接近用户本能的交互体验。这种体验往往是多感官通道的,要达到组合体验最优就需要探索不同通道间的配合与平衡,视觉通道的占用就不是越多越好。

还是以车机研究为例,案头发现,在驾驶场景中,人们需要90%以上的视觉资源维持驾驶绩效保证安全驾驶,我们的研究目的是提升语音交互效率减少用户对中控车机的关注。研究发现,当语音的引导明确、屏幕内容和语音引导配合一致时,用户花费较少的视觉资源便可获得所需信息(见方案一热力图);而当语音交互缺乏有效引导,屏幕内容与语音引导配合不当时,用户会花更多视觉资源在车机屏幕的信息加工上(见方案二热力图)。

除眼动研究实验设计和实施的通用注意事项外,AI交互设计的研究中还需注意:

基于自然交互的目标,打造真实体验场景是AI交互设计研究中重要的一环,是研究自然交互的基础。我们越来越少的使用过去基于静态网页静态物料的实验室研究设计。比如在车载环境下,变化的路况占据了行车过程中90%的视觉资源,信息多,变化快,这是一个不可忽略的因素。我们会让被试在相对安全的时段在真实道路上进行驾驶测试,累计样本时长不低于900分钟。而眼动仪技术的发展也使得实验情景更趋于自然,提高了眼动研究的生态学效度。

在保证生态学效度的同时,要兼顾研究数据的准确性。从桌面端研究到自然场景下的研究,日光是眼动数据收集中无法回避的问题。由于大多数眼动仪是依靠红外线反射原理,日光中的红外线会对眼动的校准和捕捉造成影响,导致校准通过率低。但是如车载场景研究就需要在自然光环境下进行眼动数据采集。这时,要避开正午时间或正对阳光的方向做测试。

◾与其它生理测量仪器相结合时,做好流程设计和实验控制

涉及到多种测量仪器的同时应用,在研究设计环节要特别注意流程设计,提前做好内容聚焦和研究规划。例如仪器是否全程佩戴;基线数据的获取放在哪一环节;由于眼动校准存在一定的失败率,那么是否需要把校准放在最先步骤等等。

由于不同生理测量仪器需要在各自限定条件下进行生理信号的采集,所以要关注数据采集和还原被试自由度之间的平衡,如脑电测量时,为保证信号采集的稳定性,要尽量避免头部大幅运动。此外,还要注意任务设置和时长控制,如通过眼镜式眼动仪进行眼动测试,要避免被试中途摘下眼镜导致数据丢失。

综上,我们把AI交互设计中的眼动研究于传统互联网眼动研究的变与不变总结为以下几点:

VR的嵌入,拓展了眼动研究的场景,可以快速切换实验场景,并让高危场景研究更为深入;

眼动研究内容在AI交互设计领域有所延伸,包括多通道研究及情感研究;

眼动研究更多与脑电等测量仪器及机器学习等技术手段相结合;

体验目标的变化,眼动数据不再是越多越好,而是多通道的最佳组合;

打造真实场景,做好流程规划和实验控制。

眼动研究作为探索人类视觉的工具,在PC和移动时代都发挥了重要作用。我们这一代做用户研究的人经历了传统的桌面研究,做过需要准备上百实验素材的实验室静态研究,目前正在探索基于真实场景的高自由度眼动研究,并引入脑电等更多生理测量仪器,辅以机器学习,赋予眼动研究更高价值。

原文地址:AIID 百度人工智能交互设计院

作者:百度AI交互设计院